NEWS CENTER

大家好,我是觉非科技的联合创始人刘斌,很高兴跟大家有这样线上交流的机会,来分享觉非科技和米文动力、英伟达在多传感器融合感知方面的实践。

今天分享的内容主要围绕车路协同中融合感知能力的实现方式,以及觉非科技基于各类场景所做的实践应用。希望今天的分享能让大家对于车路协同的融合感知能力有一个总体的认知。

大家都知道在自动驾驶领域里面,融合感知在车路系统里越来越重要。如果把整个自动驾驶划分成四个阶段,第一个阶段是信息交互协同,这个阶段更多的是RCO和OBO之间的通信,是把红绿灯这类的信息通过RCO、PC5或者UU5发送到车端,去给车端做协同感知,这是比较简单的协同阶段。

第二个阶段是感知决策协同,这是目前产业正在经历的阶段,这个阶段是解决了车和路之间的通讯问题后,把路面上所有交通参与者(行人、车辆、非机动车等)的运动轨迹、实时位置、状态用基于路侧的多传感器融合进行感知,同时通过RCO发送给车端,车结合自己本车的单车智能,再加上路侧通过多传感器融合,得到的大环境信息,进而去做整体的决策系统。

在很多国内的示范区、测试场,甚至在一些实际的商业化场景里面,这样的形式正在如火如荼地开展,不管是边缘计算还是激光雷达、摄像头,都是在促进产业融合感知发展,国家也出台了很多政策支持路侧协同,使自动驾驶车辆尽快进入到日常生活,这就是感知协同的阶段,需要大家一起努力,把传统的路改造成更聪明的路,同时车辆也需要具备一定的感知能力,这两者加起来才能得到比较好的环境和态势感知。

第三个阶段是控制协同,这个阶段需要车辆的OBO覆盖量达到一定程度,当车辆进入到控制协同路段后,路侧就不只是去做融合感知了,需要根据实时的动态信息对车辆进行整体的路权分配,最终达到安全最大化和交通效率最大化的目的。只有用统一的路权分配体系把车辆做更好的路权分配,自动驾驶才能够更加安全、快速的扩展运营场景。

第四个阶段是车路一体化,这个阶段的车和路已经融合到了大系统里面,不管是乘用车、商用车、特种车辆,都可以在大系统里进行系统控制感知。车和车、车和路、人和车、人和路,所有的交通参与者之间都可以得到实时的信息共享。

下面给大家看一下在感知决策协同阶段,觉非科技和合作伙伴米文动力、英伟达在实际的落地场景上做了哪些实践,也是真正能够落地的项目。

这是上海的一个路口,这个路口装上了觉非科技的融合感知系统“知寰”,它的作用是在T形路口做全面的态势感知,以及对于交通参与者运动轨迹的预测。

右图的丁字路口在南方很多城市都是比较常见的,很多都没有红绿灯,图中展示的是一个自动驾驶的测试区域,这个区域有非常多的自动驾驶车辆,同时也有人类驾驶员驾驶的车辆、行人和非机动车,在上下班高峰期,这个路口容易造成安全隐患和拥堵。

在这个场景下,对自动驾驶车辆的挑战比较大,因为没有统一的信号灯分配体系,经常会有突然逆行,或者突然从感知盲区闯出行人和非机动车,导致自动驾驶车辆进行非受迫性接管。

为解决这些问题,这个路口装了多传感器融合感知设备“知寰”(左图),所有的交通参与者和道路上的交通事件,都可以通过这套感知一体机进行感知,感知到结果后,再把结果汇总到一起,通过杆上的RCO跟车辆的OBO进行通信,同时把所有的信息上传到云端。

车路系统在这个场景主要有两个作用:一个是全息路口的感知,另一个是把感知到的信息实时上传到测试场或测试示范区的运营管理方,他们需要实时知道路面上车辆(自动驾驶车辆、特种车辆等)的运行位置、所处的状态,以及它们在这种复杂路口的表现是什么,这是自动驾驶必须具备的一环,因为在自动驾驶现还没到达非常成熟的阶段时,管理方需要知道这些车辆现在所处的状态,以及它们每天运行的路线信息。

在这其中,自动驾驶车辆需要关注的是所有机动车、非机动车和行人的信息,这些都是可以通过边缘计算,包括感知、多传感器融合感知把它放到一起,然后通过RCO进行信息共享。

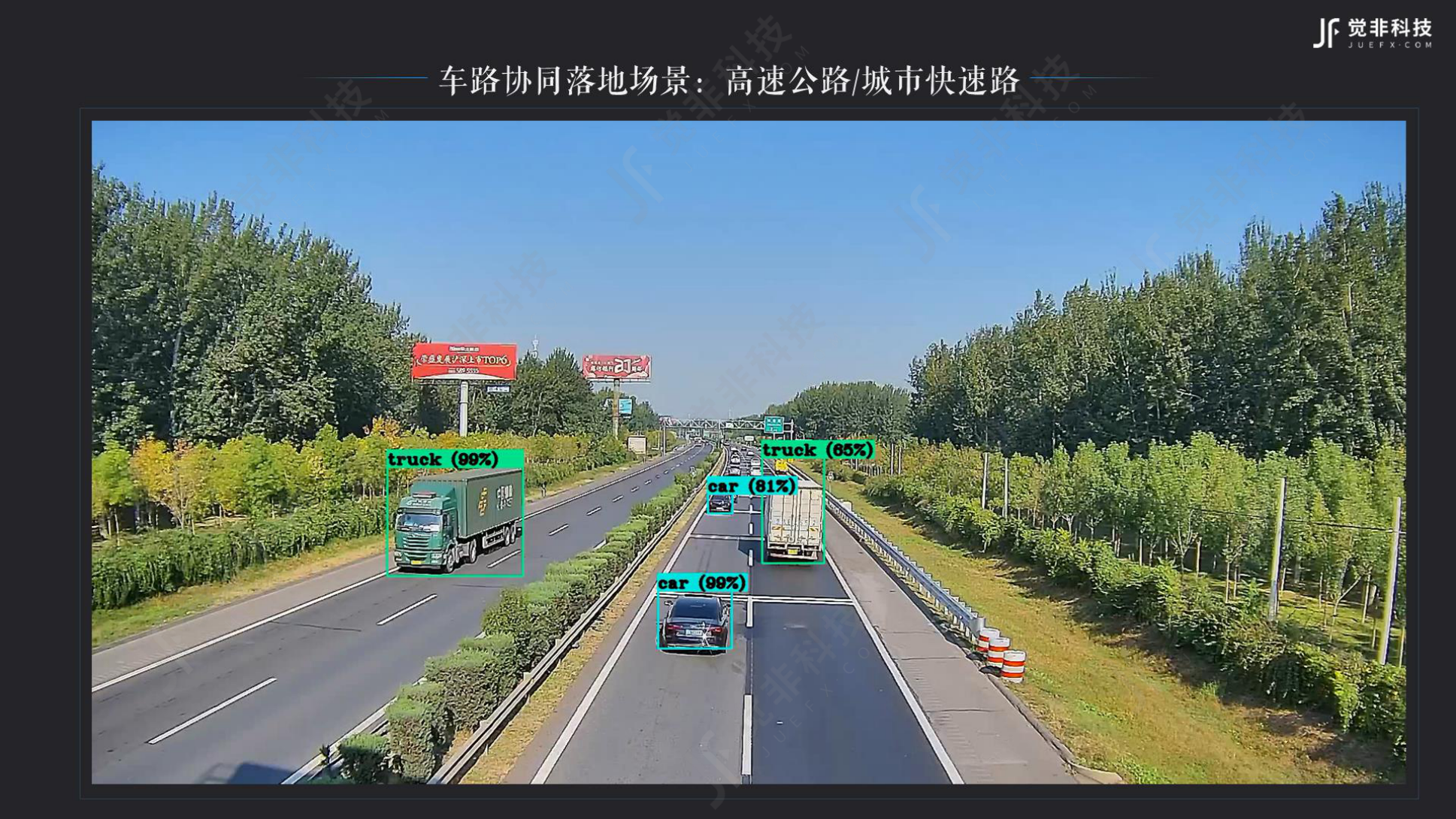

第二个场景是高速公路的场景,这里是用摄像头和激光雷达做的感知,展示的是视觉感知的结果,实际上图中是把激光雷达的点云投影到2D的框里做目标的3D感知。

大家可能会好奇,车路系统在城市道路场景中会起到协同感知的作用,那么在高速公路的场景中,它起到的作用是什么?

目前,高速公路落地的应用主要有两种,一种是把传统的交通应用用车路协同设备做集成。举个例子来讲,一些比较大型的车辆,比如载货车辆,经常会出现超限的情况,超限就是搭载的物品长和宽超过了法规允许的上限值,一般指的是体积的超限。

这种超限的情况会严重影响道路的寿命和其他交通参与者的驾驶安全,所以首先是管理的需求,在高速公路上安装激光雷达和摄像头,能够实时捕获超限的行为和信息,从而为处罚或引导提供依据。

其次,现在干线物流在高速公路的运行场景或测试场景会越来越多,有非常多的干线物流推出了编队行驶的能力,编队行驶能力要求对前方几公里未知的、单车智能感知之外的区域做协同感知,这些设备在高速公路上能为物流车辆尤其干线物流车辆,提供比较好的引导或者相关的感知信息。

高速公路不像路口那么复杂,但对事件的要求比较多,比如这里是不是出现排队了?排队的长度是多少?视野范围之内是不是出现事故了?事故影响的是哪个车道?因为事故平均流量降低到了多少?这些都是通过路侧感知设备,尤其是多传感器融合的设备进行协同感知的。

在这个场景里面,可以看到两车道加上一个应急车道,在实际部署和运行监控过程中,有非常多的车辆在这个地方走应急车道,这会对道路运行安全造成比较大的威胁。所以在高速公路上部署融合感知设备,一方面能够做交通事件的监管,另一方面也是为将来自动驾驶车辆,尤其是货车的编队行驶提供更多超视距的感知信息。

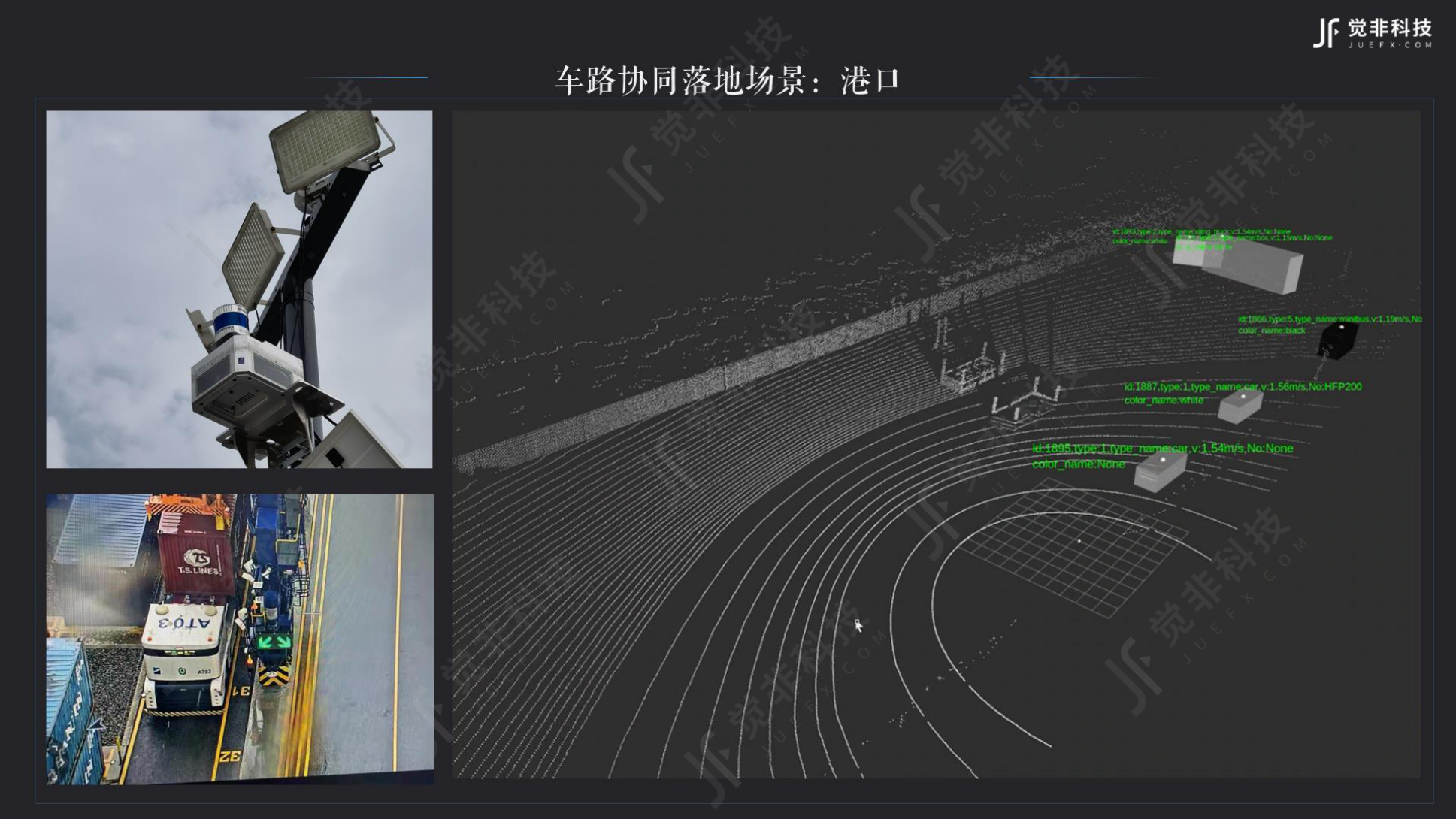

第三个场景是在港口,现在港口的自动驾驶已经成为提升效率和安全的重要手段,上图左下角是一辆自动驾驶的车辆,这里面车是纯粹无人自动驾驶的状态,在港口操作区域自动驾驶车辆和社会车辆交替行驶,自动驾驶虽然在很多港口部署了,但还没有达到100%完全无人化。在这个过程中,有人驾驶的集卡车和无人驾驶的集卡车会遇到融合协同感知和路权分配的问题。

所以在港口的场景,我们会把车路协同的设备(以激光雷达为主)装在交汇口,尤其是主干道和操作备位的交汇口,起到的作用有两个,第一个作用是刚才说到的,当自动驾驶车辆要进行作业或者作业完毕要驶出作业工位的时候,对盲区的有人驾驶车辆做感知补充。

港口里面大多都是集装箱,这些集装箱一般堆砌的高度非常高,这会造成车辆的单车感知能力比较受限,尤其是在货场中拐弯或者路口交汇的地方,如果没有车路协同设备的协同感知,这些车辆是没办法观察到来向或者去向的车辆,这就是车路协同设备在这个场景发挥的第一个作用,作为自动驾驶车辆做盲区的感知协同。

第二个作用跟单车智能的感知有关系,图中左下角蓝色部分是一个塔吊,这个塔吊的作用是把货场里堆砌的集装箱放到自动驾驶的集卡上,当塔吊路过的时候,会导致本车高精度定位偏移,尤其是在使用RTK的情况下,会导致卫星接收信号异常,这时车辆的位置会出现抖动,严重影响到后续的决策和控制。这时就需要依靠路侧的感知设备,也就是以激光雷达为主的这套设备会告诉自动驾驶车辆它的准确位置,这是第二个作用,实现港口车辆的高精定位。

另外这个场景也很有意思,本身自动驾驶的集卡车比较长,分成车头与集装箱两部分,在做感知的时候,客户要求把它当成两个目标,所以在港口这个场景里面,对集装箱这种超长目标做感知的时候,要把车头和集装箱进行两个方向的切割,也就是车头是一个单独的目标,它所搭载的集装箱也是一个单独的目标,这样会对车辆自身的姿态、控制起到很好的补充。

跟港口场景比较类似的是停车场,因为停车场容易受到遮挡,在环境光线没有很好的情况下,也有很多的自动驾驶的better case出现,这个时候用路侧或者装在场端的车路协同设备,能为车辆做很好的场端感知。

现在停车场有很多APP的方案,有基于车端感知的、有视觉感知的VSLAM,有激光雷达感知的,还有场端自动控制的,最终哪种方案能够达到一统天下的目的现在还不太清楚,但是随着车端接收路端信号能力的标配,我相信在比较难解决的场端,尤其是停像车场这种场景,用路端设备做整体协同感知的概率会比较高。

对于单车来讲,只需要具备一个协同控制和一个OBO的接收通信模块就可以了,这就是一个很好的在商用场景下做落地的项目。

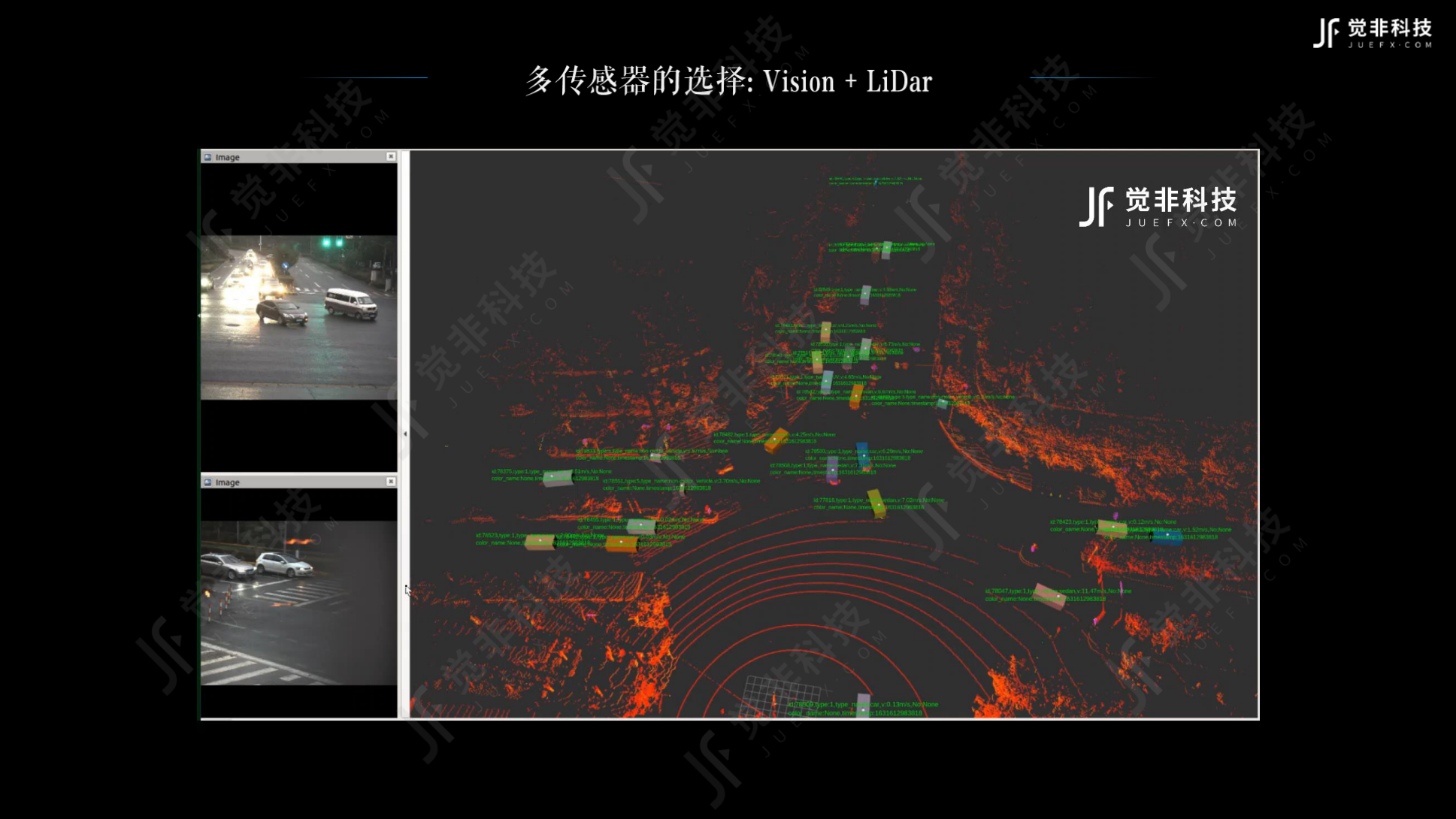

刚才讲了三个场景,第一个是路口,第二个是高速公路,第三个是停车场和港口,这几个场景里面最复杂的还是路口,这段视频是在城市的T形路口,用视觉加激光雷达做的多传感器融合感知,这里面有些目标是通过激光雷达去感知到的,有些目标是通过视觉感知到的,这个场景是非常好的多传感器融合感知的例子。

另外,这里也有一个很重要的融合场景,是激光雷达用深度学习算法生成3D bounding box的时候距离有限,对于更远处尤其是到150米左右的目标,可以结合视觉和毫米波的数据做感知距离的延长。

这里既用到了前像融合,也用到了多传感器的目标级融合,整个算法结构大家可以看一下,总共有三种传感器,一个是路口的多路摄像头,通过视觉感知用深度学习模型去产生3D目标;第二个是激光雷达,同样也是在边缘端感知MEC上去实现,也是3D目标检测;第三个是直接输出毫米波雷达结果,这三路的结果把目标的不同特征、不同位置做不同层级的融合,里面既有全像融合,也有目标级的融合,最后输出3D追踪结果,从而完成整个路口中交通参与者的完整信息输出。

这里有两个重要的前提条件,一个是三路传感器必须是比较好的稳定关系,要有在线标定也要有离线标定算法,第二个是多传感器的时钟同步必须是统一的,同时整个MEC和车端的时间也必须要统一,这里比较常用到的方法是通过GNSS传感器做快速授时。

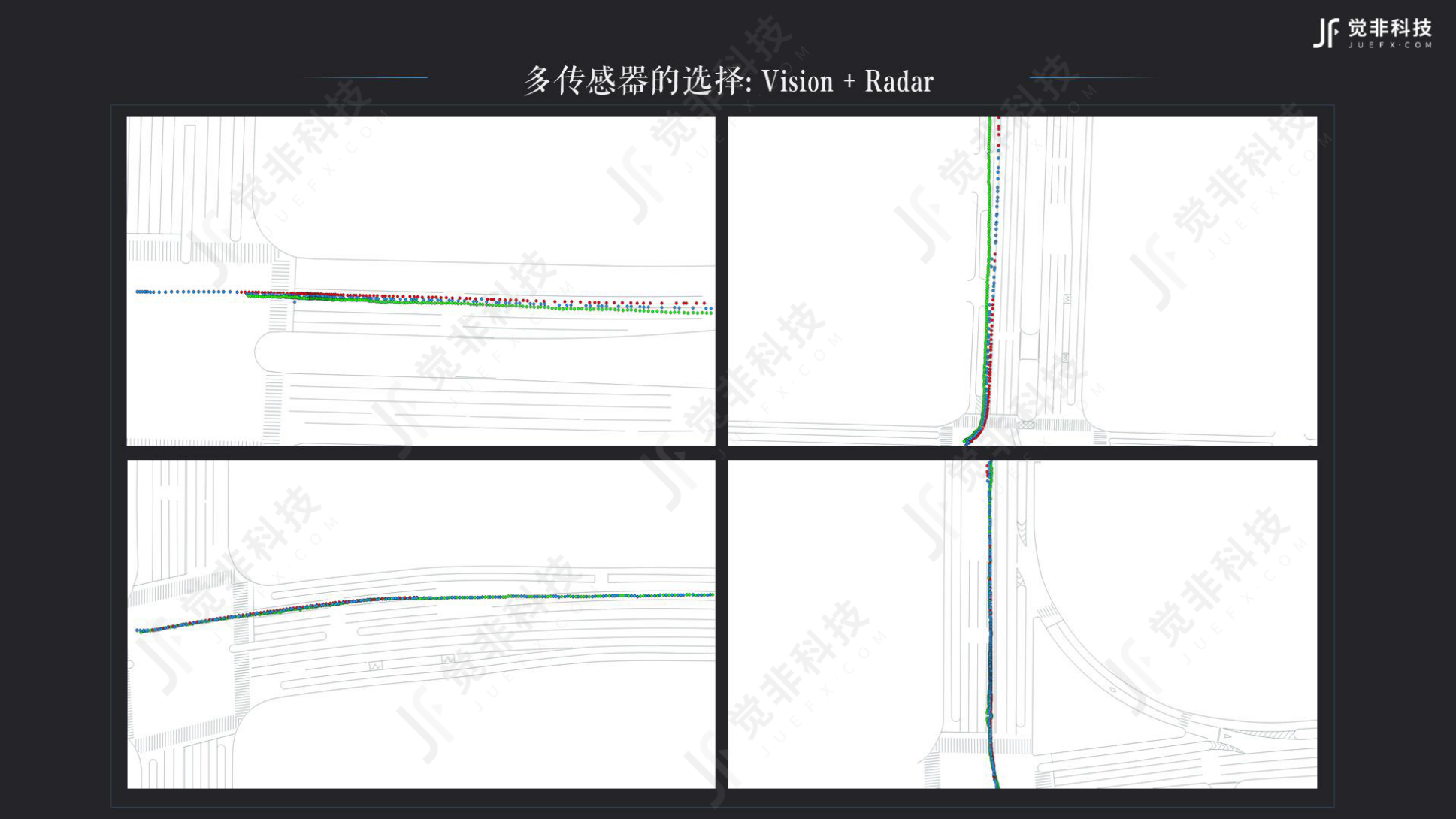

上图是传统智能交通里最常用的传感器,绿色比较密集的点是毫米波雷达输出的目标,红色点是视觉输出的目标,蓝色点是融合后输出的目标,这里用到了多传感器融合算法,在整个目标层面做位置、类型和航向的属性融合。

刚才给大家展示的这些场景,我们都是用基于米文动力MIIVII EVO Xavier 的MEC来进行处理的,在实践过程中用单台的MIIVII EVO Xavier边缘计算设备,接1路激光雷达、1-3路不等的摄像头,再通过CAN总线或网口接入毫米波雷达,把数据接入到MIIVII EVO Xavier后做视觉目标和点位目标的神经网络推理,把目标的位置计算出来,包括航向、速度、类型都是通过不同传感器输出不同的属性,然后在MIIVII EVO Xavier上做深度融合。

这是高速公路、路口、港口里面装的传感器组装在一起的样子,相当于是三个异构传感器的一体机,这一体机把MIIVII EVO Xavier集成到了整体的结构里面,大家可以看下最左侧的照片,上面有很多散热的开槽,这个在夏天已经经过了比较长时间的测试,我们跟米文动力也在实验室做了热仿真,可以保证边缘服务器稳定运行。

此外,把这三个传感器放在一起有很重要的目的,一是保证三者之间的相对关系稳定,也就是说在架设到点位之前,三个传感器就做了比较严密的传感器标定,包括绝对位置标定和多个传感器之间相对关系的标定,这个标定关系可以保证在做融合的时候,能较好的把目标的RVO重合到一起。

另一个是我们自研了基于FPGA的时间同步板,用这个时间同步板可以去做摄像头、激光雷达的时间同步,包括对MEC去做授时,授时完之后可以保证三个关系在时空上能得到比较好的统一。

下面是觉非科技跟不同的合作伙伴在车路协同场景中实际的落地项目,左侧三张是商用车辆,分别是无人物流小车、港口集卡、无人运行的BRT公交车,里面用到了车路协同的协同感知和协同决策,能够保证车辆在特殊场景里面安全高效的进行运行。

右侧是我们目前跟几家主机厂正在做的融合感知前装开发,相信大家很快就可以看到。随着融合感知技术的不断发展,包括路侧的通信设备、路侧的感知设备、路侧的边缘计算机在城市里不断推广和铺量,车上的应用也逐步会更新迭代,自动驾驶将会加速跨越式发展。

好的,今天的技术分享就到这里,非常感谢大家的聆听,希望以后有更多深度合作和沟通交流的机会,因为自动驾驶、车路协同需要软件提供商、硬件提供商、芯片厂商等等生态伙伴的一起努力,共同促进整个行业的发展。